Il Parlamento europeo ha approvato la prima legge sull’Intelligenza Artificiale (IA) delineando i perimetri di sicurezza, obblighi e divieti, nel rispetto dei diritti fondamentali e con l’obiettivo di promuovere l’innovazione assicurando all’Europa un ruolo di guida nel settore.

La legge sull’IA è il primo quadro giuridico completo in assoluto sull’IA in tutto il mondo.

Il Regolamento fa parte di un più ampio pacchetto di misure politiche a sostegno dello sviluppo di un’IA affidabile, che comprende anche il pacchetto sull’innovazione in materia di IA e il piano coordinato sull’IA. Insieme, queste misure garantiranno la sicurezza e i diritti fondamentali delle persone e delle imprese, oltre a rafforzare la diffusione, gli investimenti e l’innovazione nell’IA in tutta l’UE

Con lo storico voto del 13 Marzo – anticipato in vista dello scioglimento del Parlamento per le prossime elezioni europee – si conclude così l’iter legislativo che dovrà essere sottoposto alla verifica finale dei giuristi-linguisti con la traduzione nelle 24 lingue comunitarie per poi essere formalmente approvato dal Consiglio.

Entrerà in vigore venti giorni dopo la pubblicazione nella Gazzetta ufficiale dell’UE: la prima scadenza degli adeguamenti sarà di sei mesi, mentre le norme diventeranno completamente operative tra due anni.

Brando Benifei, il relatore del Parlamento europeo sull’AI Act, lo ha definito un regolamento “volto a limitare i rischi e aumentare le opportunità, a combattere le discriminazioni, a portare la trasparenza e i nostri valori democratici di libertà e uguaglianza all’interno dello sviluppo dell’intelligenza artificiale, sostenendo al contempo l’innovazione e la competitività”.

Negli ultimi anni, l’Artificial Intelligence (AI) ha acquisito un ruolo sempre più preponderante nella trasformazione digitale, influenzando tutti i settori, dall’industria all’assistenza sanitaria, dalla mobilità alla finanza.

Secondo l’Osservatorio Artificial Intelligence del Politecnico di Milano – Report Febbraio 2023 -, il mercato dell’Artificial Intelligence in Italia ha raggiunto un valore di 500 milioni di euro, con un +32% rispetto al 2021 e che le imprese italiane che hanno già avviato un progetto AI sono il 61% delle grandi imprese, percentuale che si ferma al 15% in ambito PMI per cui si prevede però un aumento nei prossimi 24 mesi.

Per favorire ulteriormente lo sviluppo e la diffusione di queste tecnologie l’AI ACT prevede che I paesi dell’UE dovranno istituire e rendere accessibili a livello nazionale spazi di sperimentazione normativa e meccanismi di prova in condizioni reali ( sandbox), in modo che PMI e start-up possano sviluppare sistemi di IA innovativi e addestrarli prima di immetterli sul mercato.

La regolamentazione delle applicazioni di AI rappresenta un primo passo fondamentale per un utilizzo consapevole e sicuro di questa potente tecnologia, per dare forma ad un futuro in cui l’intelligenza artificiale sarà pervasiva ma affidabile, sicura e rispettosa dei valori umani.

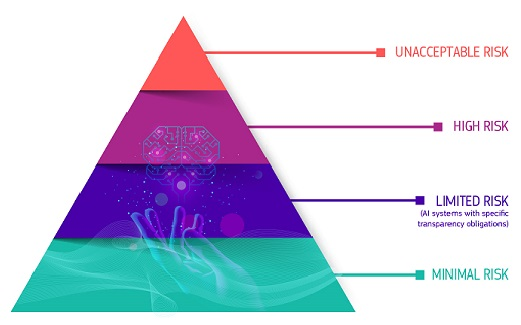

Il Regolamento stabilisce obblighi per l’AI sulla base dei possibili rischi e del livello d’impatto su una scala di quattro livelli: minimo, limitato, elevato e inaccettabile.

L’AI Act consente l’uso gratuito dell’IA a rischio minimo. Ciò include applicazioni come videogiochi abilitati per l’IA o filtri antispam. La stragrande maggioranza dei sistemi di IA attualmente utilizzati nell’UE rientrano in questa categoria.

I sistemi a rischio limitato sono soggetti a requisiti di trasparenza molto leggeri, come, per esempio, il solo obbligo a comunicare che un determinato contenuto è stato prodotto attraverso l’uso dell’intelligenza artificiale, come nel caso dei chatbot.

Per quelli a rischio elevato, è prevista una valutazione d’impatto sui diritti fondamentali prima dell’immissione sul mercato, che comprende l’obbligo di registrazione presso l’apposita banca dati dell’Unione Europea e di requisiti sui dati e sulla documentazione tecnica da presentare per dimostrare la conformità del prodotto.

I sistemi di IA identificati come ad alto rischio includono la tecnologia di IA utilizzata in infrastrutture critiche, istruzione o formazione professionale, componenti di sicurezza dei prodotti, occupazione, gestione dei lavoratori e accesso al lavoro autonomo, servizi privati e pubblici essenziali, applicazione della legge che può interferire con i diritti fondamentali delle persone, gestione della migrazione, dell’asilo e del controllo delle frontiere, amministrazione della giustizia e processi democratici.

Il regolamento vieta i sistemi di categorizzazione biometrica basati su caratteristiche sensibili e l’estrapolazione indiscriminata di immagini facciali da internet o dalle registrazioni dei sistemi di telecamere a circuito chiuso per creare banche dati di riconoscimento facciale nonché il riconoscimento delle emozioni sul posto di lavoro e nelle scuole, i sistemi di punteggio sociale (social scoring) da parte dei governi, le pratiche di polizia predittiva (se basate esclusivamente sulla profilazione o sulla valutazione delle caratteristiche di una persona) e i sistemi che manipolano il comportamento umano o sfruttano le vulnerabilità delle persone.

In alcune situazioni specifiche – previa autorizzazione giudiziaria o amministrativa e con uso limitato nel tempo e nello spazio – potranno essere utilizzati i sistemi di riconoscimento biometrico, come nel caso della ricerca di una persona scomparsa o per la prevenzione di un attacco terroristico.

L’Intelligenza Artificiale è entrata a far parte delle nostre vite attraverso macchine intelligenti che abilitano la trasformazione digitale dei processi industriali e dell’intera società

TIM Enterprise, leader dell’innovazione digitale nel nostro Paese, applica soluzioni di Intelligenza Artificiale in coerenza con il proprio Codice Etico e di Condotta e seguendo l’approccio “ethics by design”: un approccio che include le considerazioni etiche in maniera sistematica e omnicomprensiva nella progettazione e nello sviluppo delle soluzioni tecnologiche di Intelligenza Artificiale.

Al fine di garantire correttezza nei confronti di utenti, partner e della società, TIM Enterprise pone al centro dell’innovazione digitale i seguenti principi etici: centralità della persona, uguaglianza, sostenibilità, trasparenza, privacy e cooperazione.

Le soluzioni di TIM Enterprise che integrano l’Intelligenza Artificiale favoriscono il miglioramento della relazione con il cliente attraverso esperienze personalizzate con un approccio multicanale e data driven.

Per saperne di più sulle soluzioni di Intelligenza Artificiale di TIM Enterprise