L’Intelligenza Artificiale (IA) è un ramo dell’informatica che si occupa di creare sistemi in grado di apprendere, ragionare e adattarsi autonomamente. Questi sistemi sono progettati per svolgere compiti che richiedono intelligenza umana, come la comprensione del linguaggio naturale, il riconoscimento di immagini e la risoluzione di problemi complessi. L’IA è un campo di ricerca che ha attraversato diverse fasi storiche, ognuna caratterizzata da progressi significativi e nuove sfide.

La sua evoluzione è stata guidata da personaggi chiave che hanno contribuito a sviluppare nuove tecniche di apprendimento e a creare applicazioni innovative in diversi settori. Oggi, l’IA ha un impatto significativo sulla società e sull’economia, e il suo futuro sarà determinato dalla nostra capacità di affrontare le sfide etiche e sociali che essa pone.

L’Intelligenza Artificiale ha una data di nascita in qualche modo “ufficiale”: il 1956, ovvero l’anno in cui l’informatico John McCarthy propone il termine al grande pubblico e in cui proprio l’IA diventa ufficialmente una disciplina di studio all’interno del Dartmouth College di Hanover.

Se Il termine “Intelligenza Artificiale ” viene coniato nel 1956, in realtà il primo sistema IA della Storia nasce paradossalmente un anno prima: si chiama Logic Theorist – sviluppato dallo scienziato politico e sociologo Herbert Simon insieme all’informatico Allen Newell e il programmatore Clifford Shaw – ed è stato il primo programma in grado di dimostrare teoremi matematici in modo autonomo, utilizzando una forma primitiva di ragionamento simbolico.

Negli anni ’50 e ’60 del secolo scorso numerosi scienziati e ricercatori hanno contribuito alla fondazione dell’IA, beneficiando di investimenti governativi che hanno sostenuto la ricerca in questo campo.

Durante il convegno di Darmouth ebbe un ruolo fondamentale il lavoro di Alan Turing, considerato uno dei padri dell’informatica moderna: già nel 1936 aveva posto le basi per i concetti di calcolabilità, computabilità e la macchina di Turing. Nel 1950, lo stesso Turing, scrisse l’articolo intitolato “Computing machinery and intelligence”, in cui proponeva quello che sarebbe divenuto noto come test di Turing. Secondo il test, una macchina poteva essere considerata intelligente se il suo comportamento, osservato da un essere umano, fosse considerato indistinguibile da quello di una persona.

Ma la storia dell’Intelligenza Artificiale ha origini lontane: già ai tempi degli antichi greci il poeta Esiodo descrive, con la storia di Talos, la creazione da parte dell’essere umano di un essere artificiale a sua immagine e somiglianza.

Un evento cruciale nella storia dell’IA è stato sicuramente il Perceptron di Frank Rosenblatt del 1928: un esemplare primordiale di rete neurale a uno strato che avrebbe dovuto essere in grado di eseguire compiti e sviluppare idee originali ma che si rivelò fallimentare.

Nel 1966 è stata la volta di Shakey, uno dei primi robot mobili dotati di Intelligenza Artificiale. Sviluppato presso il laboratorio di ricerca di Stanford, ha dimostrato la capacità di ragionamento e pianificazione autonoma è ha rappresentato un passo importante verso la realizzazione di sistemi intelligenti in grado di interagire con il mondo reale.

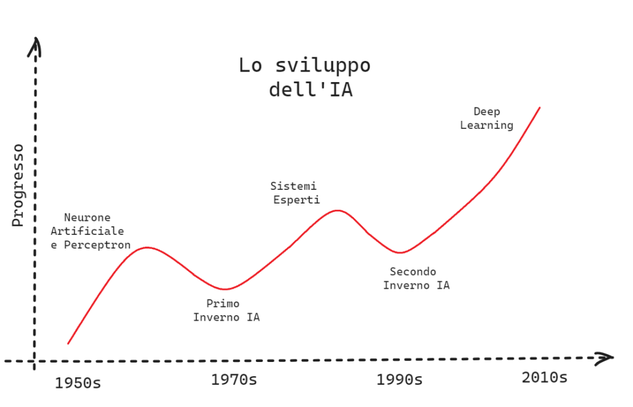

Negli anni ’70, l’IA si trovò però ad affrontare diverse sfide che ne rallentarono il progresso.

Uno degli eventi significativi fu la critica da parte di Marvin Minsky e Seymour Papert – i fondatori del MIT AI Lab, centro di ricerca dedicato all’IA ancora oggi tra i più prestigiosi al mondo – ai modelli di perceptron nel risolvere problemi complessi, come replicare il comportamento della funzione XOR ( regola della disgiunzione esclusiva). A seguire, la pubblicazione del Rapporto ALPAC nel 1966 evidenziò le limitazioni dell’IA nel campo della traduzione automatica dal russo all’inglese, considerata chiaramente un obiettivo strategico per gli Stati Uniti.

Queste analisi, insieme al taglio dei finanziamenti pubblici portarono al cosiddetto “inverno dell’Intelligenza Artificiale ” che durò fino agli anni ’80.

Questo periodo di scetticismo ha evidenziato la necessità di sviluppare modelli di Intelligenza Artificiale più complessi e adattabili oltre ad una maggiore consapevolezza delle sfide e dei problemi che accompagnano lo sviluppo dell’IA.

Negli anni ’80 si verificò una ripresa significativa della ricerca e dello sviluppo nell’ambito dell’IA, in particolare dei sistemi esperti: apprendimento automatico knowledge based con l’utilizzo di regole – in particolare if/then – e inferenze per affrontare problemi complessi.

Anche grazie alla diffusione del computer nelle imprese, dalla seconda metà degli anni ’80 alcuni sistemi di Intelligenza Artificiale dedicati all’industria (ad esempio per la gestione della logistica) cominciarono ad avere un certo successo. È il caso di Stanford Cart, un carrello sviluppato a Stanford in grado di eseguire compiti fisici complessi, come il trasporto di oggetti in un ambiente con ostacoli.

In particolare, la prima Intelligenza Artificiale applicata in ambito commerciale fu R1, sviluppata nel 1982 dall’azienda Digital Equipment per configurare gli ordini di nuovi computer: quattro anni dopo, l’azienda era in grado di risparmiare 40 milioni di dollari all’anno.

Gli anni ’80 sono stati anche caratterizzati dallo studio teorico di algoritmi fondamentali per l’IA, come l’algoritmo di back-propagation di Geoffrey Hinton – uno dei padri della moderna IA – che sfrutta la retroazione dell’errore nei processi di apprendimento migliorando la capacità delle reti neurali di adattarsi ai dati.

Nonostante i notevoli progressi, verso la fine degli anni ’80 e l’inizio degli anni ’90, l’IA ha affrontato rallentamenti in quanto i sistemi esperti presentavano diversi limiti, tra cui la loro dipendenza dalle informazioni fornite e l’adattabilità limitata. La manutenzione e l’aggiornamento della base di conoscenza richiedevano sforzi e costi significativi per cui ci fu un taglio di investimenti nella ricerca che all’epoca era ancora ad esclusivo appannaggio di fondi governativi.

La vera esplosione dell’IA c’è stata negli anni 2000 con la diffusione del Machine Learning e del Deep Learning.

Nel 2015 l’Introduzione delle reti neurali multi-layer ha segnato un punto di svolta per apprendere rappresentazioni complesse di dati mentre Il Deep Learning ha rivoluzionato molti campi, come l’elaborazione del linguaggio naturale e la computer vision.

L’incremento della potenza di calcolo è stato un altro fattore cruciale così come la condivisione delle conoscenze e lo sviluppo delle Comunità AI: l’apertura del codice, dei dataset e delle pubblicazioni scientifiche. Framework open source come TensorFlow e PyTorch – supportati principalmente da Google e Facebook e dai colossi hi-tech con fondi considerevoli per la ricerca – hanno dato un forte impulso allo sviluppo dell’IA.

Oggi, l’IA è parte integrante di molte tecnologie che utilizziamo quotidianamente, come i motori di ricerca, gli assistenti virtuali (ad esempio, Siri e Alexa) e le piattaforme di raccomandazione (come Netflix e Amazon). Inoltre, l’IA sta trovando applicazioni in settori come la medicina, finanza, industria e trasporti, con un impatto sempre maggiore sulla società e sull’economia.

Mentre continuiamo a esplorare le possibilità dell’IA, è fondamentale considerare anche le sfide etiche e sociali che accompagnano il suo sviluppo e utilizzo. L’IA offre grandi promesse, ma è necessario affrontare attentamente questioni come la privacy, la sicurezza, la responsabilità e l’impatto sociale per garantire un utilizzo responsabile e benefico dell’Intelligenza Artificiale.

TIM Enterprise, leader dell’innovazione digitale nel nostro Paese, applica soluzioni di Intelligenza Artificiale in coerenza con il proprio Codice Etico e di Condotta e seguendo l’approccio “ethics by design”: un approccio che include le considerazioni etiche in maniera sistematica e omnicomprensiva nella progettazione e nello sviluppo delle soluzioni tecnologiche di Intelligenza Artificiale .

Le soluzioni di TIM Enterprise che integrano l’Intelligenza Artificiale favoriscono il miglioramento della relazione con il cliente attraverso esperienze personalizzate con un approccio multicanale e data driven.

Per saperne di più